hud|支持动态变焦,剑桥大学基于LiDAR的全息HUD方案解析( 二 )

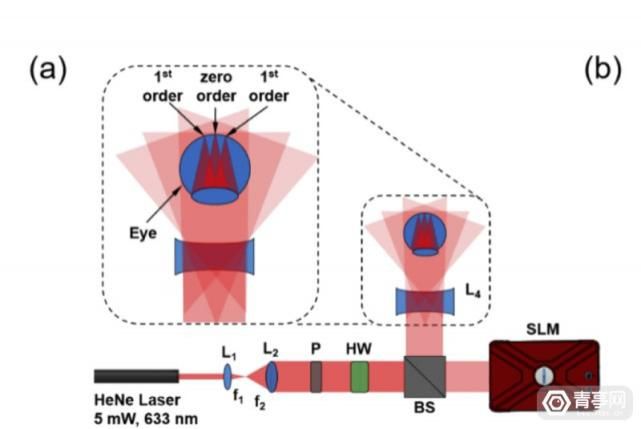

在3D成像过程中,系统会将不同焦点平面的物体转化为同一个物体平面,然后再将物体平面显示在人眼面前特定的焦距,从而模拟多样物体在不同深度距离的效果,实际无需调节焦距即可自然查看AR指示。

关于测试结果

【 hud|支持动态变焦,剑桥大学基于LiDAR的全息HUD方案解析】实验发现,该方案显示的焦距越远(大于600毫米),效果越清晰、对比度越高、与真实环境的位置越对齐。此外,该方案的眼动范围可达7毫米x7毫米,对角线FOV达6.856°。同时,SLM的像素间距越小,FOV越大。

文章插图

LiDAR 数据与点云数据的集成将有效提升AR导航的安全性,可以实时预测道路障碍。 LiDAR 点云可以识别隐藏在驾驶员视野之外(在其他物体后面)的道路障碍物。 在 AR 模式下将扫描的 LiDAR 数据集成到全息 HUD 中,可以通过实时提醒驾驶员来增强障碍物识别。 使用光学扫描仪识别驾驶员,人类识别技术可以与机器学习方法相结合,在汽车领域创建安全应用。

实际上,许多自动驾驶汽车已配备LiDAR传感器,这项方案也许可以直接用于自动驾驶汽车中。

未来,该方案将支持画面布局设置,还可以同时现实多个3D物体,甚至同时渲染不同焦点平面的AR内容。比如:远处的路牌可以缩小尺寸,近处的路牌可以放大,提升自然观感。而且,这些功能未来将支持自定义。另外,科研人员正在着手缩小光学元件的体积,以用于车载系统。参考:newswise

推荐阅读

- 999卢比|一加Nord 2 5G手机海外发布 搭载天玑900支持65W快充

- 投资|一村资本首支QFLP基金项目完成签约,规模30亿人民币 | 投资动态

- 2022闲鱼为什么不支持信用卡付款 闲鱼可以用信用卡吗

- 5G|“不支持5G,还不降价”,面对质疑任正非强势回应

- z40|努比亚 Z40 Pro 通过 3C 认证:支持无线磁吸充电,不附赠充电器

- 微软Win11|微软Win11不再支持WEP等Wi-Fi加密协议

- fps游戏|锐龙6000+RTX 3060,支持双显三模技术,天选3锐龙版明日凌晨开售

- hdmi|支持华为、苹果,手机、笔记本皆可使用,优越者九合一扩展坞评测

- redmi|库克尴尬!Redmi K50电竞版不仅支持120W充电,亮屏也很快

- 手表|支持超级SIM卡的耳机,是未来还是“石墨烯”?