苹果公司|苹果将检测美国用户手机中的虐童图片,斯诺登:这是大规模监控

当地时间8月5日,苹果公司公布了扫描美国iPhone手机上儿童性侵图片的系统,这一举动获得了儿童保护组织的支持,但也引发了网络安全人员的担忧,认为这一系统可能遭到滥用,被政府用来“监视民众”。

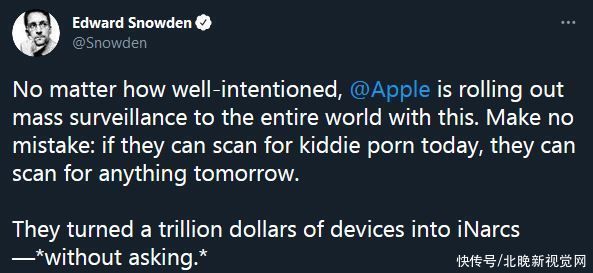

此前揭露美国政府大规模监控计划的斯诺登也在推特发声,称苹果会用这一系统,“给全世界带来大规模监控”。

美联社解释说,苹果公司的这一系统名叫“neuralMatch”,它会在图片上传到iCloud(苹果的云端存储服务)之前进行扫描。如果它找到了匹配的图像,将会通知审核人员检查。若确认存在儿童色情内容,那么苹果方面将关闭账户,并通知美国国家失踪和被剥削儿童中心。

文章插图

路透社:苹果将检测上传iCloud的虐童照片实际上,这一系统并不能真正“看到”图像,而是采用“数字指纹”(digital fingerprints)的技术,通过辨识图片中的关键信息,与现有的儿童性侵图像数据库内容对比。

美国国家失踪与受剥削儿童中心的首席执行官约翰·克拉克(John Clark)在一份声明中拥护苹果的这项系统:“由于有这么多人在使用苹果产品,这些新的安全措施有可能拯救那些在网上被诱骗的儿童,以及防止儿童性侵图片的传播……事实是,隐私和儿童保护可以共存。”

实际上,多年来微软、谷歌和脸书等科技公司,一直在分享已知的儿童性侵图片数字指纹。此前,苹果也曾利用类似的技术,扫描存储在iCloud中的用户文件和照片,防止儿童色情内容。

但与之前的技术相比,苹果此次计划在照片上传之前就进行扫描,这也引发了外界对隐私权和监控的担忧。

“这绝对是一个可怕的想法,因为它将导致针对我们的手机和笔记本电脑的大量监控。”剑桥大学安全工程教授罗斯·安德森(Ross Anderson)如此评价说。

【 苹果公司|苹果将检测美国用户手机中的虐童图片,斯诺登:这是大规模监控】约翰斯·霍普金斯大学的网络安全教授马修·格林(Matthew Green)说:这将会突破界限,政府会要求每个人都这么做。”

而曾在脸书工作的网络安全研究员亚历克·马费特(Alec Muffett)表示,苹果此举是是“个人隐私的巨大倒退”。他说:“苹果正让隐私保护倒退,《1984》(英国小说家乔治·奥威尔的反乌托邦小说)已成为可能。”

格林还提及另一种可能,即苹果的这一系统可能会被“用来诬蔑无辜的人”,给他们发送看似无害的图片,目的是引发儿童色情匹配。这可能会骗过苹果的算法,并提醒执法部门。“研究人员已经能够很容易地做到这一点。”他谈到欺骗这类系统的能力时说。

此前揭露美国大规模监控“棱镜”计划的斯诺登,也在推特上发声:“不管多么善意,苹果正在用这个对全世界进行大规模监控。毫无疑问:如果他们今天能扫描到儿童色情片,他们明天就能扫描到任何东西。”

文章插图

但十多年前发明了照片匹配技术“PhotoDNA”的哈尼·法里德(Hany Farid)认为,苹果的系统存在被滥用的可能性,但他表示,与儿童性侵作斗争的必要性远远超过了这一可能性。

称扫描技术是一套新的儿童保护系统的一部分,该系统将“随着时间的推移而发展和扩展”。这些功能将作为iOS 15的一部分推出,预计将于下个月发布。

《金融时报》报道说,该系统将“随着时间的推移而发展和扩展”。这些功能将作为操作系统iOS 15的一部分推出,预计将于下个月发布。

(_原题为:苹果将检测美国用户手机中的虐童图片,斯诺登:这是大规模监控)来源:观察者网流程编辑:TF021

推荐阅读

- 海外市场|凭借近2亿的年销量,小米三年超越苹果的可能性有多大?

- 手机|苹果玩的是什么把戏,华为市场份额减少,反而iPhone13价格下调了

- Be苹果推出NBA限量版Beats耳机,庆祝NBA成立75周年

- iphone|苹果教你如何让 iPhone 电池保持健康

- 工具|VR音乐制作工具《Virtuoso》将于3月登陆Quest和SteamVR

- 技术|华为手机将出新款手机,假如没有受到限制,结果不敢想象

- 苹果|手机市场再次洗牌,华为跌至第六,苹果被荣耀超越,第一名很低调

- enco|OPPO Enco X2官宣2月24日发布,将为消费者带来「录音室级音质」

- 冠军版|骁龙8Gen1+12GB+256GB,限量一万台,首销或将快速售罄

- 荣耀|2021年第4季度手机销量出炉,荣耀首次位列第二,销量仅次于苹果