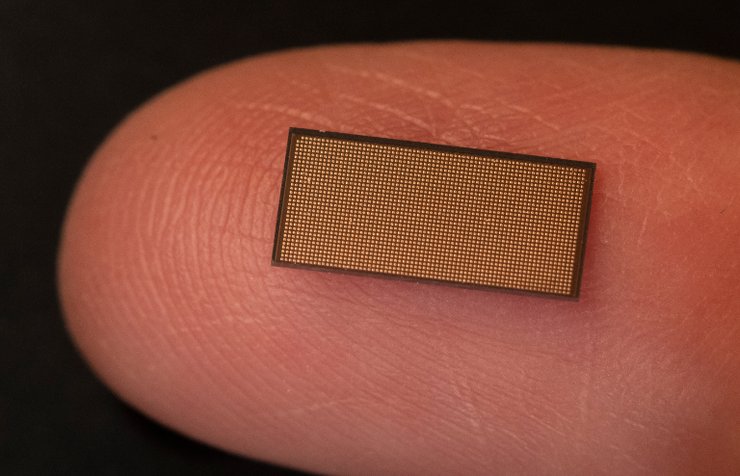

神经|英特尔下一个时代的『CPU』,10倍以上性能提升,1000倍能耗降低

芯片行业有一种说法:“算力可以换一切”。

也就是当芯片算力足够大的时候,许多难题都能迎刃而解,这也解释了摩尔定律如此受关注的原因。但随着AI、大数据的发展,传统的芯片越来越难以满足新兴应用的需求,业界需要全新类别的芯片。

量子计算、神经拟态计算(也称类脑计算)是两个重要的突破方向。相比量子计算,神经拟态计算的关注度略低一些,但神经拟态计算已经被英特尔证明在一些应用中,可以带来至少10倍的性能提升,同时实现1000倍的能耗降低。

英特尔神经拟态计算实验室总监Mike Davies在近日宣布英特尔第二代神经拟态芯片Loihi2后与雷锋网的交流中说:“英特尔可能不是第一家将神经形态技术商业化的公司,因为英特尔的规模,我们正在寻找巨大的机会。所以,我们必须以十亿美元的水平看待所有的商业机会。我们并不急于商业化,但当我们商业化的时候,希望这是一项通用技术,可以像CPU、GPU在多种应用中为广大客户提供巨大价值。”

从某种意义上来说,无论是英特尔正在探索的量子计算还是神经拟态芯片,都有可能成为地位可以比肩现有CPU的“下一个时代的CPU”。

Mike说至少要在3年后才可能看到英特尔正式推出神经拟态的商业化产品,但Loihi已经取得的成果值得我们期待神经拟态芯片的时代。

文章插图

神经拟态芯片与传统芯片有何本质差别?

谈论神经拟态芯片的优势之前,先解释一下神经拟态计算这种全新的计算方式。神经拟态计算受到生物学原理的启发,基于对现代神经科学的理解,从晶体管到架构设计,算法以及软件来模仿人脑的运算。

神经拟态计算与传统芯片和传统处理方式有很多不同,比如,人脑中没有单独的存储器,没有动态随机存取存储器,没有哈希层级结构,没有共享存储器等等。“存储”和“处理器”错综复杂地深绕在人脑里,在人脑的结构中有“神经元”的存在。

系统编程层面也有很大的区别,传统的CPU或GPU结构以顺序操作或指令/程序来思考,在神经拟态芯片中,计算过程需要神经元单元的互动。神经拟态芯片处理答案的步骤也许不按照程序的执行步骤,更多的是根据动态的交换反应。

文章插图

当然也有相似之处,在电脑中,以数字化核心相互交流基于事件的信息,叫做脉冲,这点和人脑传递信息的方式相似。

相比传统计算与神经拟态计算原理的区别,更多人应该更加关心神经拟态计算表现在应用中的优势。Mike说:“有一系列问题人脑可以很好地处理,所以我们可以期待神经拟态计算对于真实数据的处理速度或反应时延的性能效率提升,尤其是对于真实数据样本的适应力或快速学习能力的提升。”

神经拟态芯片擅长处理哪些任务?

2017年时,英特尔就对外公布了其第一代神经拟态芯片Loihi,随后便开始与业界共同探索神经拟态计算的可能性和可以发挥优势的场景,并建立了神经拟态研究社区(INRC),如今已经有将近150个成员机构。

INRC今年新增的成员包括福特(Ford)、佐治亚理工学院(Georgia Institute of Technology)、美国西南研究院(SwRI)、美国菲力尔公司(Teledyne FLIR)。

“我们调查了最近所有的结果,研究了IEEE文献,在很多不同的领域都得出,Loihi的结果超过了使用最好的CPU和GPU算出的结果,其中很多出自感知领域。”Mike表示“特别是和新的事件相机传感器(新型视觉传感器)集成时,神经拟态芯片能够以非常低的功率水平来执行手势识别和其他视觉推理任务。”

推荐阅读

- AMD市值首超英特尔,500亿买赛灵思是福还是祸?

- 投稿|英特尔的“付费解锁硬件性能”构想恐怕是个潘多拉魔盒

- 英特尔|惠普第八代游戏家族产品重磅首发,硬核升级助力玩家全速出击

- gpu|英特尔独立显卡第一季度上市,台式机独显第二季度见

- 加速器|英特尔将推出Arctic Sound-M加速卡 用于服务器领域

- 台式机|i9强无敌,笔记本硬刚台式机,曾经的那个英特尔,它又回来了?

- 英特尔|英特尔CEO:有意组财团买下ARM

- 英伟达|英特尔代工再发力,称有兴趣参与收购Arm

- 基辛格|英特尔CEO:有意组财团买下ARM

- 投稿|华润的“酒局”:寻找下一个汾酒